Η Apple εκπαίδευσε επιτυχώς ένα νέο μοντέλο Τεχνητής Νοημοσύνης ικανό να αναγνωρίζει χειρονομίες τις οποίες δεν είχε “δει” ποτέ κατά τη διάρκεια της εκπαίδευσής του.Η τεχνολογία αντλεί δεδομένα αποκλειστικά από αισθητήρες ενσωματωμένους σε wearable συσκευές (όπως το Apple Watch) και όχι από κάμερες.Το σύστημα καταγράφει και αναλύει σε πραγματικό χρόνο τις μυϊκές συσπάσεις και τις μικροκινήσεις των τενόντων του καρπού.Η εξέλιξη παρακάμπτει τους περιορισμούς οπτικής επαφής του Apple Vision Pro, επιτρέποντας τον χειρισμό συσκευών ακόμα και όταν τα χέρια βρίσκονται εκτός του οπτικού πεδίου των καμερών.

Η αλληλεπίδραση του χρήστη με τα ψηφιακά περιβάλλοντα μεταβάλλεται δραστικά. Σύμφωνα με πρόσφατα δημοσιευμένα ερευνητικά δεδομένα, η Apple προχωρά στην ανάπτυξη ενός προηγμένου συστήματος Τεχνητής Νοημοσύνης το οποίο επιτρέπει την αναγνώριση εντελώς νέων χειρονομιών, χρησιμοποιώντας δεδομένα αποκλειστικά από αισθητήρες wearable συσκευών.

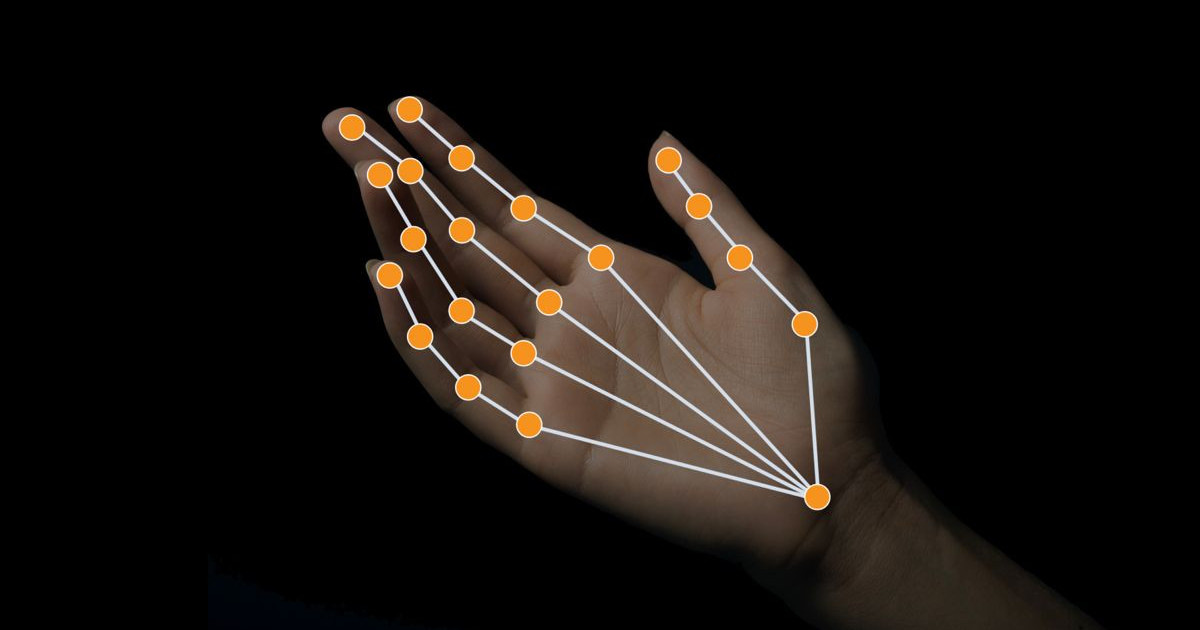

Η συγκεκριμένη τεχνολογία παρακάμπτει πλήρως την ανάγκη οπτικής καταγραφής από κάμερες, στρέφοντας το ενδιαφέρον στην ανάλυση της μυϊκής δραστηριότητας και της εμβιομηχανικής του ανθρώπινου χεριού.

Πώς λειτουργεί το νέο σύστημα αναγνώρισης χειρονομιών της Apple;

Το νέο AI μοντέλο της Apple χρησιμοποιεί αισθητήρες από wearable συσκευές για να καταγράφει μυϊκά σήματα και μικροκινήσεις του καρπού. Χωρίς να απαιτεί οπτική επαφή μέσω κάμερας, το σύστημα επεξεργάζεται τα δεδομένα τηλεμετρίας σε πραγματικό χρόνο, επιτρέποντας την ακριβή αναγνώριση νέων χειρονομιών και διευρύνοντας τις δυνατότητες χειρισμού.

Η προσέγγιση της Apple διαφοροποιείται σημαντικά από τα παραδοσιακά μοντέλα μηχανικής μάθησης. Συνήθως, για να αναγνωρίσει ένα σύστημα μια χειρονομία (όπως το “pinch” ή το “swipe”), απαιτείται η τροφοδότησή του με χιλιάδες ώρες δεδομένων που απεικονίζουν τη συγκεκριμένη ακριβώς κίνηση. Οι ερευνητές της εταιρείας, ωστόσο, εστίασαν στη δημιουργία ενός γενικευμένου μοντέλου. Αξιοποιώντας αλγόριθμους βαθιάς μάθησης, το σύστημα είναι πλέον σε θέση να ερμηνεύει και να κατηγοριοποιεί “άγνωστες” χειρονομίες. Το AI κατανοεί τη θεμελιώδη κινηματική του χεριού και μεταφράζει τον συνδυασμό των μυϊκών συσπάσεων σε ψηφιακή εντολή, ανεξάρτητα από το αν η συγκεκριμένη κίνηση υπήρχε στο αρχικό dataset εκπαίδευσης.

Η μετάβαση από την οπτική καταγραφή στη βιομετρική τηλεμετρία

Ο περιορισμός των σημερινών συστημάτων Spatial Computing, συμπεριλαμβανομένου του Apple Vision Pro, έγκειται στην εξάρτησή τους από οπτικούς αισθητήρες. Για να καταγραφεί μια εντολή, τα χέρια του χρήστη πρέπει να βρίσκονται απαραίτητα εντός του οπτικού πεδίου των καμερών της συσκευής. Αυτή η συνθήκη προκαλεί συχνά κόπωση, καθώς οι χρήστες αναγκάζονται να διατηρούν τα χέρια τους σε συγκεκριμένες γωνίες.

Η μεταφορά του φορτίου αναγνώρισης στο επίπεδο του καρπού επιλύει αυτό το κατασκευαστικό εμπόδιο. Μέσω αδρανειακών μονάδων μέτρησης (IMU – επιταχυνσιόμετρα και γυροσκόπια) υψηλής ακρίβειας και πιθανότατα νέων αισθητήρων ηλεκτρομυογραφίας (EMG), μια wearable συσκευή τύπου Apple Watch μπορεί να ανιχνεύσει την πρόθεση κίνησης τη στιγμή που ο εγκέφαλος στέλνει το ηλεκτρικό σήμα στους μύες. Αυτό πρακτικά σημαίνει ότι ο χρήστης μπορεί να αλληλεπιδρά με το οικοσύστημα της Apple έχοντας τα χέρια του στις τσέπες, κάτω από ένα τραπέζι ή κατά τη διάρκεια έντονης σωματικής άσκησης.

Η τεχνική υλοποίηση ενός τέτοιου συστήματος ενέχει σημαντικές δυσκολίες. Η ανατομία του κάθε χρήστη (μυϊκή μάζα, ποσοστό λίπους, δομή τενόντων) είναι μοναδική, γεγονός που καθιστά την ομοιόμορφη λήψη σημάτων εξαιρετικά πολύπλοκη. Εδώ ακριβώς υπεισέρχεται η δύναμη της μηχανικής μάθησης που αναπτύσσει η Apple.

Η AI αναλαμβάνει να απομονώσει την ηθελημένη κίνηση (signal) από τις ακούσιες μικροκινήσεις ή τους κραδασμούς του περιβάλλοντος (noise).Το λογισμικό παραμετροποιείται συνεχώς στο παρασκήνιο, μαθαίνοντας το προσωπικό κινητικό “αποτύπωμα” του εκάστοτε χρήστη.Για την αποφυγή καθυστερήσεων (latency) που θα κατέστρεφαν την εμπειρία χρήσης, η επεξεργασία των νευρωνικών δικτύων πραγματοποιείται τοπικά (Edge AI) μέσω των επεξεργαστών της σειράς Apple Silicon (NPU/Neural Engine), διασφαλίζοντας παράλληλα την ιδιωτικότητα των βιομετρικών δεδομένων.

Η ενσωμάτωση αυτής της τεχνολογίας θα δημιουργήσει ένα νέο επίπεδο διαλειτουργικότητας. Ένα μελλοντικό Apple Watch δεν θα λειτουργεί απλώς ως οθόνη ειδοποιήσεων, αλλά ως ο κεντρικός ελεγκτής για ολόκληρο το οικοσύστημα του σπιτιού και της εργασίας. Η δυνατότητα αθόρυβου και αόρατου χειρισμού αλλάζει τα δεδομένα για επαγγελματίες που απαιτούν hands-free περιβάλλοντα, καθώς και για άτομα με κινητικές δυσκολίες, προσφέροντας πρωτοφανείς δυνατότητες προσβασιμότητας.

Η συγκεκριμένη έρευνα επιβεβαιώνει την κατεύθυνση που ακολουθεί η Apple προς τη δημιουργία ενός αόρατου, διάχυτου περιβάλλοντος χρήσης. Εξετάζοντας το θέμα από τη σκοπιά της πραγματικής χρήσης, ο οπτικός έλεγχος των χειρονομιών στο τρέχον Vision Pro, αν και εντυπωσιακός, συχνά απαιτεί μια αφύσικη εγρήγορση από τον χρήστη. Η μεταφορά αυτού του ελέγχου σε ένα ρολόι λύνει το πρόβλημα της φυσικής κόπωσης.

Το ζητούμενο πλέον είναι η ακρίβεια σε πραγματικές συνθήκες: Πώς θα συμπεριφέρεται το AI όταν ο καρπός είναι ιδρωμένος κατά τη διάρκεια γυμναστικής ή όταν το λουράκι του ρολογιού δεν είναι απολύτως σφιχτό. Αυτές οι “υποκειμενικές ακαταστασίες” της καθημερινότητας θα κρίνουν την τελική επιτυχία της τεχνολογίας.